A Inteligência Artificial como realidade incontornável

A Inteligência Artificial veio para ficar. É necessária, de forma transversal, uma adaptação às transformações e desafios emergentes, ante as exigências de um mercado cada vez mais competitivo e em constante mutação. Perante este fenómeno, que não é assim tão recente, surgiu a necessidade de, a nível regulamentar, esclarecer zonas cinzentas e estabelecer orientações claras para a utilização das várias ferramentas disponíveis. É neste contexto que a União Europeia assumiu um papel pioneiro, ao elaborar aquele que é o primeiro texto normativo destinado a regular a utilização da Inteligência Artificial (IA), o Regulamento (UE) 2024/1689, de 13 de junho, conhecido como AI Act.

AI Act: Âmbito de aplicação e enquadramento jurídico

Impõe-se, pelas mais elementares normas do Direito da União Europeia, a aplicação direta, a todos os Estados‑Membros, das regras emanadas pelas Instituições Europeias, sendo que, em Portugal, tal aplicação encontra o seu fundamento no artigo 8.º da Constituição da República Portuguesa, tendo sido, no seio do ordenamento jurídico nacional, designada pelo governo a ANACOM como a autoridade de supervisão e fiscalização do AI Act. Para além disso, o presente regulamento é ainda aplicável em países terceiros, quando o Sistema de IA seja proveniente destes últimos, mas implementado ou utilizado no mercado da União.

Implementação faseada do AI Act

Publicado em 2024, o AI Act não se encontra, todavia, plenamente em vigor, tendo sido estrategicamente concebido para uma implementação faseada, com vista a permitir uma adaptação progressiva dos diferentes setores. Assim, o regulamento, que entrou formalmente em vigor a 1 de agosto de 2024, iniciou desde essa data um processo gradual de aplicação [1]. Assinalam-se as seguintes datas de relevo:

- 2 de fevereiro de 2025: As práticas de risco inaceitáveis constituem a categoria cuja resposta deverá ser mais célere, a fim de mitigar os seus efeitos, sendo, por isso, a prioridade já vigente e de possível consulta do artigo 5.º do diploma em análise;

- 2 de agosto de 2025: Entrada em vigor das regras relativas à implementação de autoridades notificadoras, organismos notificados, modelos de IA de finalidade geral (GPAI), que incluem os grandes modelos de linguagem (LLMs), assim como também o regime sancionatório. Para os modelos GPAI já existentes antes desta data, está previsto um período transitório, até 2 de agosto de 2027, para a sua plena adaptação;

- 2 de agosto de 2026: Aplicação do AI Act, na sua integralidade, exceptuando-se o Artigo 6.º, n.º1, relativo aos Sistemas de IA enquadráveis na categoria de Risco Elevado;

- 2 de agosto de 2027: Aplicação das regras relativas à classificação de Sistemas de IA de Risco Elevado e das suas obrigações.

Para além destas, o regulamento também prevê outras etapas/fases, nomeadamente quanto a obrigações adicionais que ainda serão susceptiveis de avaliação, e que se estenderão até 2030 e 2031.

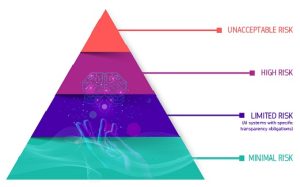

O modelo europeu de risco

O AI Act estabelece uma pirâmide de restrições na utilização de Inteligência Artifical, classificando os Sistemas de IA com base em categorias de risco, podendo ser enquadrados em 4 graus, consoante o seu nível de perigosidade.

- Risco Inaceitável: Englobam Sistemas de IA que conflituam com os valores da UE, nomeadamente Sistemas que utilizem técnicas de manipulação subliminar de comportamentos. Também se enquadram dentro desta gama de risco os seguintes comportamentos: Exploração nociva de vulnerabilidades; Social Scoring; Avaliação e previsão do risco de infração penal individual; Recolha de dados não direcionada, para desenvolver bases de dados de reconhecimento facial; Reconhecimento de emoções seja em contexto laboral ou instituições de ensino; Categorização biométrica; Identificação biométrica remota em tempo real (com especial ressalva para as autoridades policiais em certos casos muito específicos).

- Risco Elevado: Englobam-se neste espectro sistemas de IA que representam perigo substancial para direitos fundamentais. Aqui incluem-se práticas como scoring de crédito, a subscrição de seguros de vida e saúde e a gestão de infraestruturas críticas em setores-chave; processos de recrutamento e seleção, análise e filtros de candidaturas e avaliação de candidatos, etc. Aqui o que está em causa é assegurar o cumprimento dos requisitos necessários para que a utilização destes sistemas de IA se mantenha segura e confiável.

- Risco Limitado: Sistemas de Risco Limitado devem meramente cumprir obrigações de transparência, nomeadamente o dever de informar claramente que se está a interagir com um Sistema de IA. São exemplos deste tipo, a interação com chatbots e deepfakes [2].

- Risco Mínimo: São aqueles que não apresentam um impacto significativo sobre os direitos fundamentais ou a segurança das pessoas. Aqui enquadram-se filtros de spam, assistentes de redacção de texto, A grande maioria dos sistemas de IA atualmente utilizados na UE pertencem a esta categoria.

Regime sancionatório do AI Act

Atendendo ao quadro sancionatório previsto no Capítulo XII, temos:

- € 35 milhões ou 7% do volume de negócios anual (o que for superior) para situações de práticas de IA proibidas;

- € 15 milhões ou 3% para a violação de outras obrigações;

- € 7,5 milhões ou 1% por prestação de informações incorretas.

Em cada categoria de infração, o montante aplicável corresponde ao valor inferior entre os dois montantes para as PME, incluindo start-ups, e ao valor superior para as restantes empresas.

Obrigações práticas para as empresas

O AI Act inaugura um novo domínio obrigatório de compliance empresarial, impondo às entidades que utilizam Sistemas de IA a adoção de mecanismos estruturados de controlo e gestão de risco.

Destarte, as empresas devem, a curto prazo:

- Identificar todos os Sistemas de IA utilizados internamente;

- Classificar cada sistema segundo o modelo de risco previsto no AI Act;

- Determinar e implementar as obrigações legais aplicáveis a cada nível de risco;

- Promover a literacia em IA como pilar da cultura de compliance;

- Adotar uma política interna de utilização de IA, integrada no sistema de compliance da organização.

Conclusão

No essencial, com o AI Act pretende‑se, em estreita articulação com o princípio de human oversight, assegurar que as decisões relevantes tomadas por Sistemas de IA permaneçam sujeitas a controlo, intervenção e responsabilidade humana. Neste quadro mais amplo de governação digital, importará também considerar a forma como o AI Act interagirá com outros instrumentos da União Europeia, nomeadamente com a Lei de Serviços Digitais (LSD), a Lei dos Mercados Digitais (LMD), a Lei de Resiliência Cibernética (LRC) e a Diretiva NIS2, que em conjunto contribuirão para um ecossistema digital mais seguro.

O AI Act não pretende travar a inovação, mas discipliná-la, garantindo que o desenvolvimento tecnológico avança com segurança, responsabilidade e supervisão humana efetiva, redefinindo o equilíbrio entre competitividade e proteção de direitos fundamentais.

Conteúdo da autoria de Jorge Neves de Oliveira, Advogado estagiário.

[1] É nesta senda de ideias, que a Comissão Europeia concebeu a Single Information Platform, que centraliza informações sobre o AI Act e as obrigações de conformidade, apoiada por ferramentas complementares como o AI Act Service Desk, o AI Act Explorer e o Compliance Checker, destinadas a facilitar a aplicação segura e eficiente da legislação.

[2] Nem todos os deepfake se enquadram nesta classe. O AI Act define o conceito da seguinte forma: “an AI‑generated or manipulated image, audio or video content that resembles existing persons, objects, places, entities or events and would falsely appear to a person to be authentic or truthful”. O n.º 4 do artigo 50.ºestipula que “Deployers of an AI system that generates or manipulates image, audio or video content constituting a deep fake, shall disclose that the content has been artificially generated or manipulated”. Isto é, a única regra substancial relativa a este fenómeno é de que haja clara informação de que o mesmo foi gerado ou alterado por IA. Mediante esta informação, é admissível a inferência de que os mesmos se enquadrem na categoria de Risco Limitado que impõe meramente regras de transparência, mas vejamos o seguinte exemplo: Avizinhando-se as eleições presidenciais e, com isso, alguém – seja um indivíduo ou uma empresa – que tenha a intenção de prejudicar o resultado eleitoral de determinado candidato desenvolve um vídeo gerado por IA, utilizando a figura física do candidato e programando-o para que este teça comentários discriminatórios relativamente à orientação sexual, cor, religião, faixa etária, etc. O Artigo 6.º, n.º 8 estabelece expressamente que Sistemas de IA que possam influenciar eleições ou referendos devem ser classificados como de alto risco, garantindo a salvaguarda da integridade do processo democrático e da confiança pública. Por isso, é adequado que determinadas temáticas, como conteúdos relacionados com processos eleitorais, sejam tratadas com graus de risco mais restritivos, mesmo quando fique claro que foram geradas artificialmente, em benefício da proteção da sociedade e dos direitos fundamentais.